生态的下一章节:当 Context 成为 AGI 的进化密码

作者:0xWelt,kimi-k2-thinking-turbo

AGI 从来不是哪家公司的闭门造车,而是生态与智能的双向奔赴。在这场奔赴中,「Context」(上下文)正在从一个技术概念,演变为整个社区共同书写的进化论。它不仅是模型理解世界的窗口,更是生态拓展智能边界的画布。

今天,我们站在又一个转折点上。当社区开始为 AI 提供结构化、场景化的 Context,而非简单的 Prompt 或工具时,AGI 的进化轨迹正在悄然改写。让我们先回望来路,看看 Context 管理策略如何一步步走到今天。

第一章:咒语时代——System Prompt 与 User Input 的朴素探索

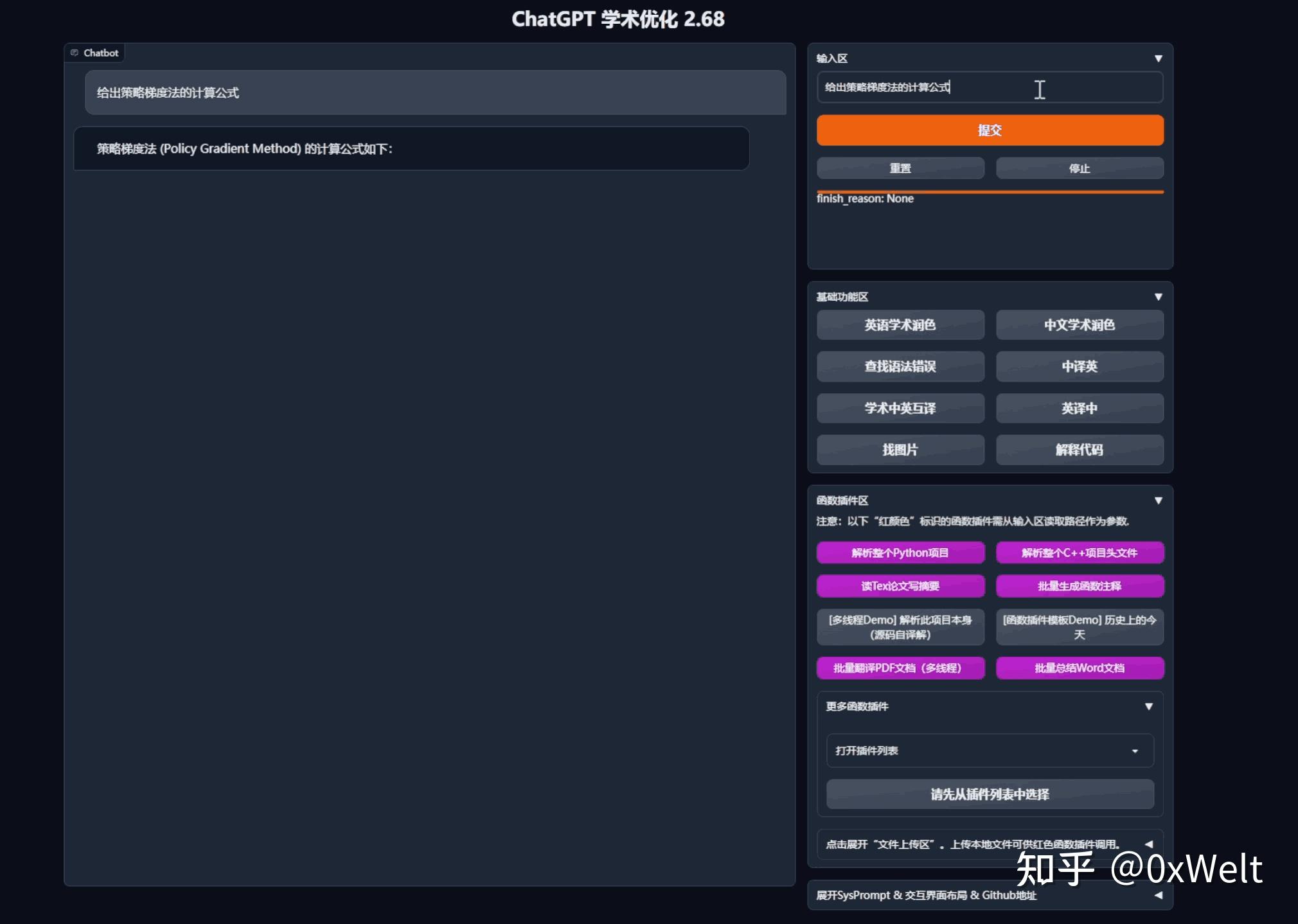

一切始于 2022 年底那个引爆全球的冬天。ChatGPT 初代系统建立在简单的「System Prompt + User Input」二元结构之上,这定义了人机交互最基础的模式。社区很快发现,通过精心设计的”魔法咒语”——那些冗长而精密的 User Prompt——可以让模型在特定领域展现出超越基础能力的惊艳表现。

典型案例就是风靡一时的”Academic GPT”:用户需要输入大段指令,要求模型扮演学术论文润色专家,规定从语法、逻辑到引用格式的数十条细则。这些 Prompt 如同炼金术士的配方,在社区间口口相传。

但这种方式的天花板很快显现:

- 能力边界低:当时模型的 Instruction Following(指令遵循)能力尚处萌芽期,复杂指令往往执行走样

- 迁移性差:为 A 模型调优的”咒语”在 B 模型上常常失灵,每个新模型都意味着重新摸索

- 体验割裂:用户需要记忆和输入大量模板,交互天然笨重

这一阶段的遗产近乎空白,却留下一个至关重要的启示:模型需要更结构化的能力引导,而非碎片化的文本咒语。

第二章:工作流的进击——Fixed Agent Workflow 的工业化尝试

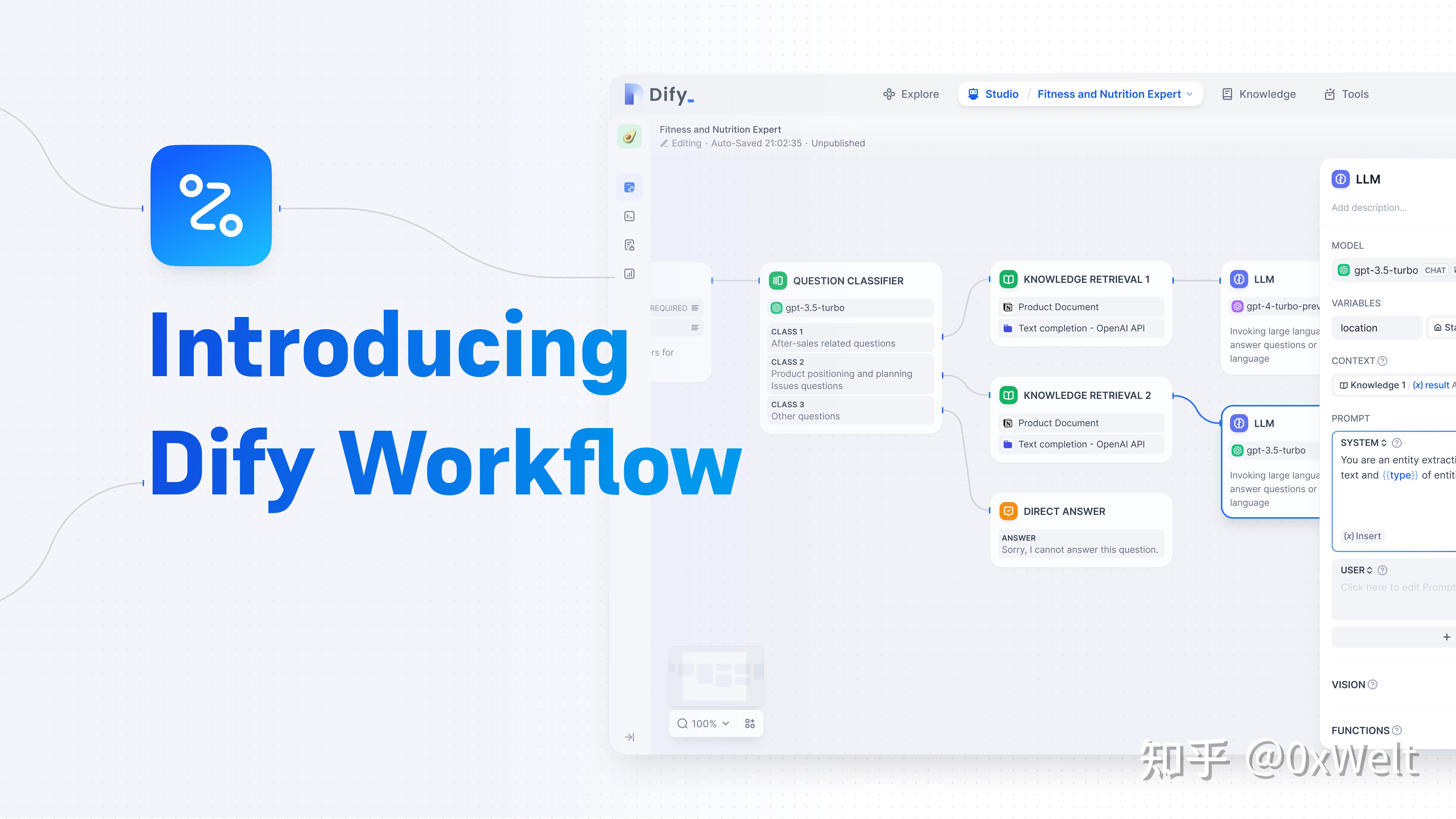

2023 年,Dify.ai、扣子(Coze)、LlamaIndex 等平台崛起,带来了「固定工作流」的新范式。开发者针对特定场景,用可视化界面搭建多轮 Agent、设计工具调用链条,配合 RAG 外挂知识库,将 LLM 真正带入 Agent 时代。

这是质的飞跃:模型从单次对话走向长期任务,从纯文本交互扩展到工具调用。社区基于此造出了无数 Agent 产品,有开源的自动化运维助手,也有闭源的行业知识库问答系统。Workflow 技术让 LLM 得以更久地运行,获得更多交互能力。

然而,其缺陷同样明显:

- case-by-case 定制:每个功能都需要一整套沉重的工作流,为喝一杯咖啡要部署一套点单系统

- 迁移成本高昂:为 GPT-4 优化的 Workflow 在 Claude 上可能表现迥异

- 灵活性缺失:流程一旦固化,就难以应对真实世界的动态变化

尽管如此,这一阶段留下了宝贵的认知资产:

- 多次交互可以超越单次 LLM 的能力上限——“越人工越智能”的悖论在此显现

- Agent Workflow 并未消失,而是在进化。今天我们用 harness(框架)或 scaffold(脚手架)来表达类似概念,但赋予了 Agent 更大的自主决策空间

第三章:MCP 革命——动态智能体的工具狂欢

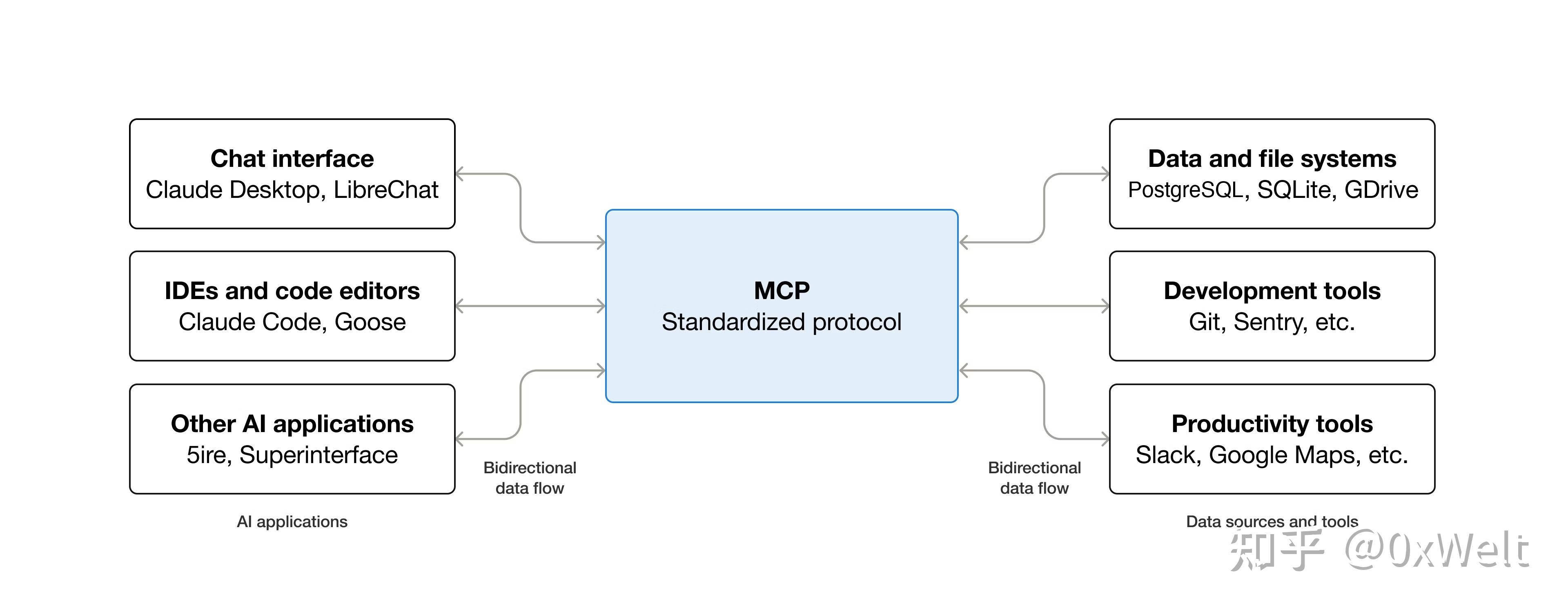

2024 年末到 2025 年初,一场静悄悄的革命随着 MCP(Model Control Protocol)标准席卷而来。这并非全新概念——OpenAI 早在 2023 年 6 月就定义了 Tool Declaration 和 Tool Call 规范——但 MCP 真正让工具实现的成本降到冰点。

社区爆发式响应:大量数字世界 API 被快速对齐到 MCP 格式,从 GitHub 操作到外卖下单,从数据库查询到智能家居控制,一个庞大的 MCP 市场瞬间成型。与此同时,以 Claude 为代表的基模展现出强大的 multi-step toolcall 能力,能够自主迭代调用工具完成复杂任务。

Fixed Workflow 的枷锁被打破:Agent 不再需要预设 rigid 流程,而是可以根据目标动态规划路径。能力边界和泛化性同时提升,似乎 AGI 触手可及。

但问题随之浮现:

- 伪需求泛滥:MCP 本质只是 API 的格式包装,对已有 API 场景开发成本极低,导致大量”开发者比用户多”的荒诞局面

- AGI 幻觉:社区陷入”接入足够多 MCP 就能实现 AGI”的迷思,忽视了模型本身的能力天花板

- Context 污染:平铺式滥用 tool declaration 导致上下文灾难,数百个工具定义挤占窗口,模型 Instruction Following 能力被严重挑战。为缓解此问题,主流 Agent 框架纷纷限制工具数量——Cursor 编辑器一度将上限设为 80 个

危机孕育智慧,这一阶段的经验深刻改变了后续设计哲学:

- 统一规范能激发社区洪荒之力——标准化是生态繁荣的基石

- Context 管理必须精细化——“hide tool result”等简单策略的出现,预示了更系统化的 Context 退出机制

第四章:Skills 崛起——上下文管理的升维战争

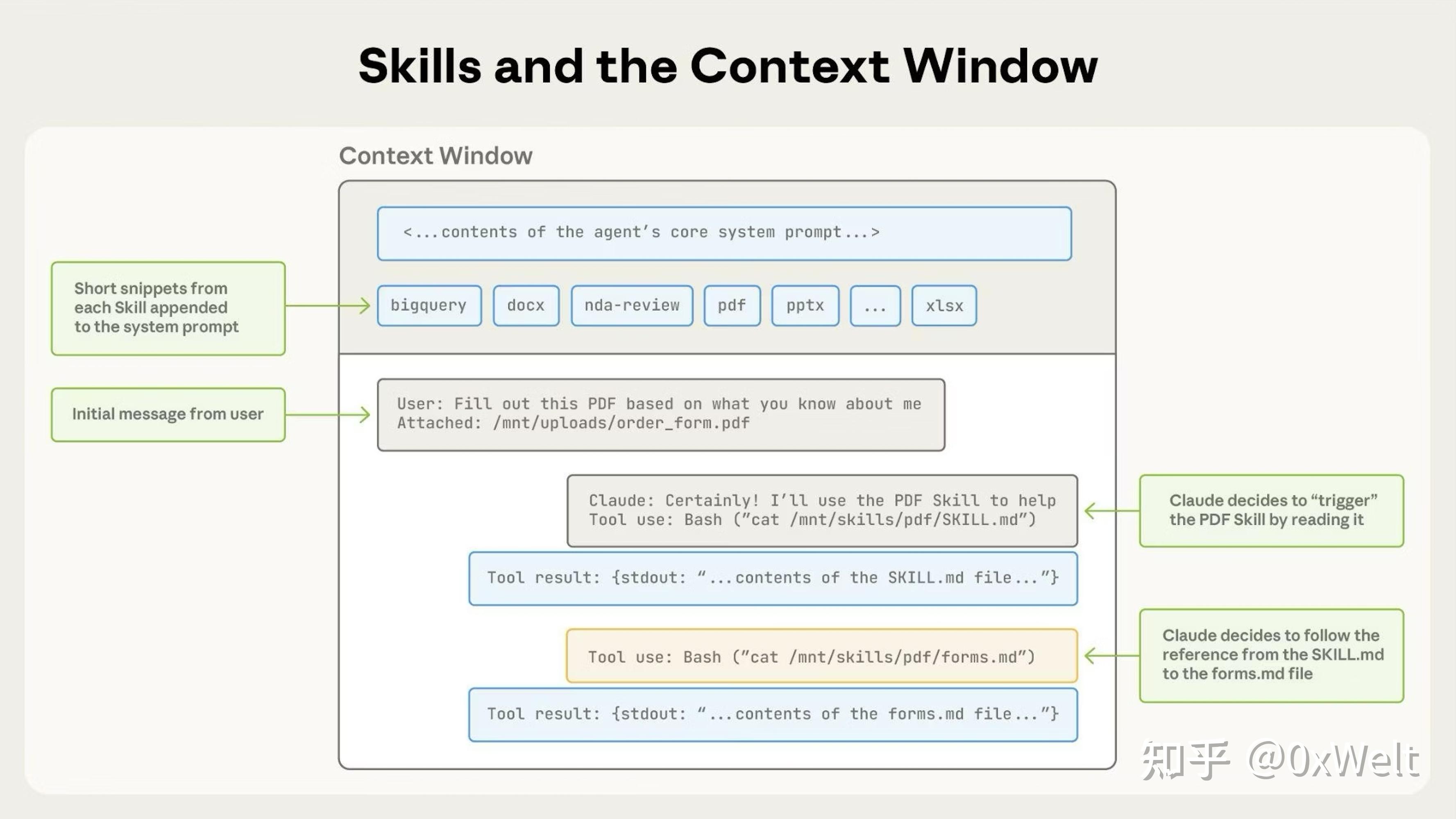

当 MCP 的平铺式暴露走到极限,Skills 应运而生。这不是简单的工具重组,而是 Context 管理策略的升维。

Skills 为何更优?它实现了三重突破:

- 层次化暴露:将扁平的工具列表组织成树状结构,按需展开,既避免 Context 污染,又节省宝贵的上下文窗口

- 主动性 Context:模型自主决策何时获取、获取哪层 Context,而非被动接受所有信息

- SOP 级指令:不仅是”能做什么”(MCP 的”我有一个 XX 工具”),更是”要怎么做”——内置详细的标准作业流程,相当于给工具打了智能补丁

更具颠覆性的是,许多 Skills 完全由自然语言定义,无需编程。这极大降低了社区参与门槛,让业务专家而非程序员也能为生态贡献 Context 资产。某种程度上,这是对第二阶段 Agent Workflow 的复兴与超越——用自然语言的灵活性,复活了工作流的结构化优势。

但这同时对模型提出新挑战:

- 主动上下文控制能力:能否在几十轮工具调用后,依然记得最初被提示的某个 Skill 存在?

- 长上下文记忆能力:如何在深度调用链中保持对高层 Context 的感知?

经验已然清晰:

- Context 必须层次化 + 主动暴露

- 社区共建的不仅是工具,更是流程性知识——SOP、最佳实践、领域方法论

正在发生的趋势:Context 管理的精细化演进

从上述演进史,我们可以清晰看到三条延续性主线:

一、从平铺到层级:可扩展性的胜利

被动获取所有 Context 的时代正在终结。更精细、更节约、可扩展性更强的层级化暴露成为主流。这不仅是工程优化,更是认知范式的转变——Context 的获取应当是一次信息觅食,而非信息轰炸。

二、模型自主性持续提升

Bitter Lesson(苦涩的教训)在此持续发力:随着基模智能增强,Instruction Following 能力不断突破,开发者可以定义更复杂的结构,而模型能理解并执行。Agent Workflow 正变得”less structure”——从需要代码定义的 rigid 流程,进化到自然语言描述的柔性 Skills。结构越少,智能越多。

三、社区参与门槛持续降低

生态的广度决定智能的高度。当贡献 Context 不再需要编程能力,当业务专家可以直接用自然语言定义 Skills,社区的创造力被彻底释放。这种民主化进程,正在快速拓展基模的能力边界。

下一章节:从预定义到场景原生

但故事未完。新的趋势正在萌芽,它将重塑 Context 的供给方式。

趋势一:从「预先定义」到「场景提供」

过去的 Context 都是预先定义的:开发者写好 MCP server,打包 Skills,用户手动选择加载。未来的 Context 将由场景主动提供。

想象一个世界:咖啡店的经营者不再需要开发 App 或小程序,而是实现一个「Context 接口」——当用户的 Agent 进入地理围栏或扫描店内二维码时,自动接收到该场景的 Context 包。这个 Context 包含:

- 菜单与推荐(不再是给人看的 GUI,而是给 Agent 看的结构化数据)

- 下单协议(类似 Skill 的自然语言 SOP)

- 支付流程

- 等待时间模型

从做给人看的 GUI,到做给 Agent 看的 Context 协议——这是数字世界交互范式的根本转移。

趋势二:从「只进不出」到「灵活退出」

当前的 Context 管理基本是单向的:加载、加载、再加载,直到窗口爆炸。未来需要的是类似 Python with 语句的上下文管理器:既定义进入,也定义退出。

当用户离开咖啡店场景,Agent 应自动:

- 归档详细交互日志(”点了一杯拿铁,焦糖换香草,少冰”)

- 从活跃 Context 中移除该场景的 MCP/Skills

- 仅保留浓缩摘要(”在蓝瓶咖啡消费 35 元”)

这种 Context 退出机制既能避免长期污染,又能实现精准记忆,是长期运行的 Agent 系统的必备能力。

一杯咖啡看未来

用一个简单的例子串联新旧世界:

旧范式:

进入咖啡店 → 扫描二维码 → 跳出小程序/H5 页面 → 用户手动点单支付

新范式:

进入咖啡店 → Agent 自动发现场景 Context → 主动告知用户:”我检测到蓝瓶咖啡的菜单,需要为你介绍一下吗?” → 用户自然语言:”来杯少冰的美式,豆种要埃塞俄比亚” → Agent 自主完成选择、定制、下单、支付 → 预测等待时间并设置提醒 → 离开场景后自动清理 Context,只保留消费记录

用户回归纯粹意图表达,所有中间过程由 Agent 在场景化 Context 的指引下自主完成。

结语:走向 Context 原生的智能生态

从咒语到 Workflow,从 MCP 到 Skills,再到场景原生 Context,我们看到一条清晰的主线:Context 正从人工输入的附件,变为生态共生的基础设施。

AGI 的密码不在于某个闭源模型的参数量,而在于社区能否构建一个上下文丰富、动态、场景化的数字世界。当每个咖啡馆、每个图书馆、每个实验室都为 AI 提供原生 Context 时,智能才会真正”涌现”。

这不仅是技术的演进,更是协作范式的革命。从比用户还多的开发者,到比开发者还多的场景参与者,生态的下一章将由所有数字空间的维护者共同书写。

Context 不再是模型要处理的问题,而是世界为智能提供的答案。